Быстрее в восемь раз, легче в четырнадцать. Новая ИИ-модель бьёт все рекорды, несмотря на свою компактность

NewsMakerЛокальные LLM в телефоне — больше не призрачная мечта, а ближайшее будущее.

Легковесные языковые модели долго считались компромиссом между скоростью и качеством. Однако перспективный американский стартап предлагает иной подход, обещая, что мощный ИИ сможет работать прямо на устройствах , без облаков и лишних затрат энергии.

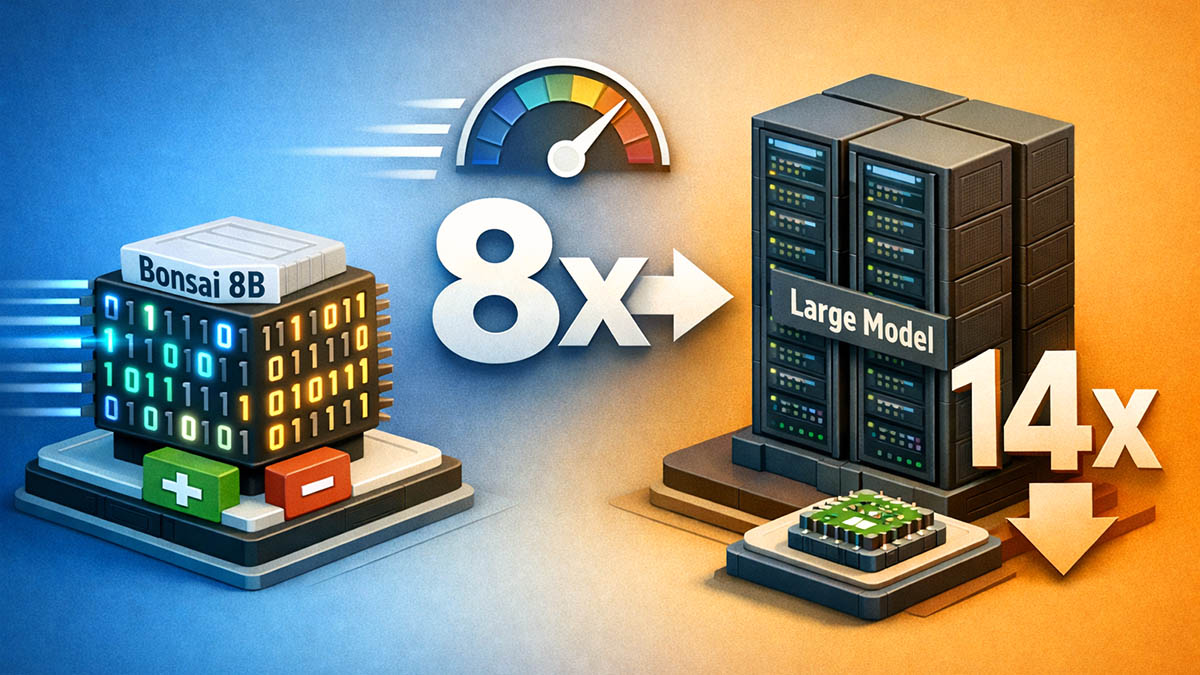

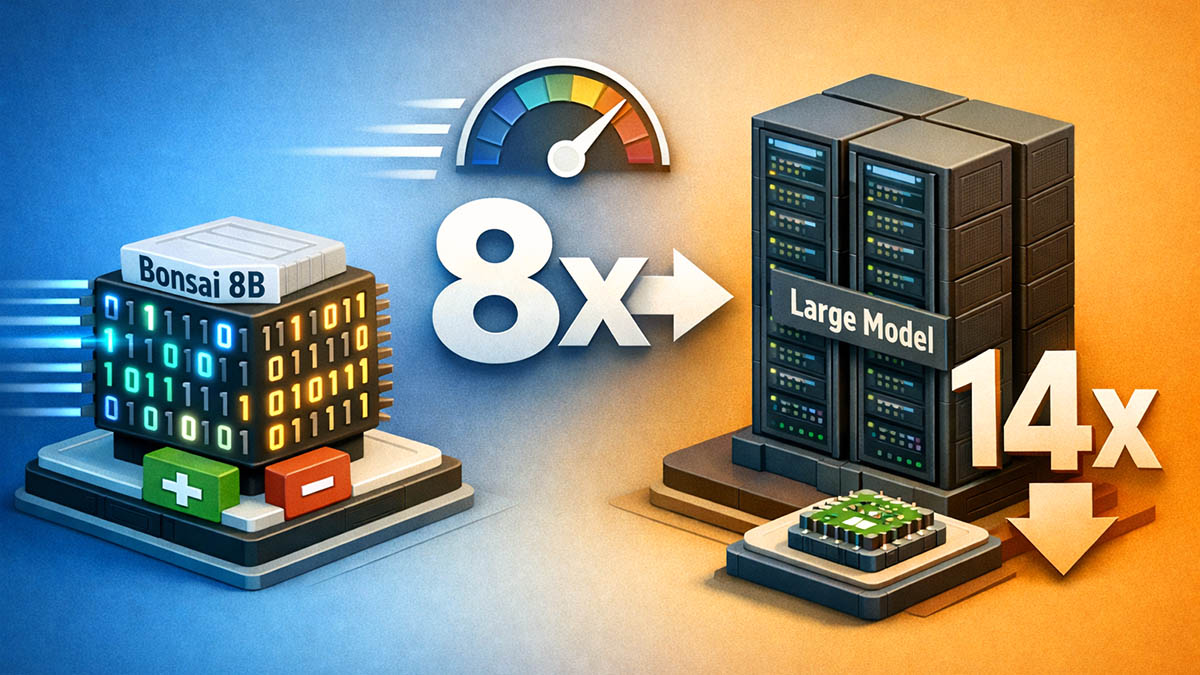

Компания PrismML представила модель Bonsai 8B с необычной архитектурой, где каждый вес нейросети хранится всего в одном бите — фактически как знак «плюс» или «минус». За счёт такого упрощения модель занимает около 1,15 ГБ памяти, оставаясь сопоставимой по качеству с другими решениями того же класса. По данным разработчиков, Bonsai 8B получилась в 14 раз компактнее, работает до 8 раз быстрее и требует в пять раз меньше энергии на периферийных устройствах.

Классические языковые модели на базе трансформеров используют миллионы и миллиарды параметров, представленных в виде чисел с высокой точностью. Чем выше точность — тем больше памяти требуется и тем стабильнее результаты. Уменьшение разрядности обычно ухудшает качество, особенно при сложных рассуждениях и работе с инструментами. В PrismML утверждают, что сумели обойти эти ограничения благодаря новой математической базе, разработанной командой под руководством профессора Калифорнийского технологического института Бабака Хасиби.

Вместо традиционных чисел с плавающей точкой модель использует общий коэффициент масштабирования для групп параметров. Такой подход позволил сохранить способность к логическим цепочкам и точному следованию инструкциям, которые раньше страдали при сильном сжатии.

Разработчики предлагают оценивать модели по новому показателю — «плотности интеллекта». Он учитывает не только точность, но и размер модели. По этому критерию Bonsai 8B заметно опережает конкурентов, включая Qwen3 8B, хотя в ряде тестов уступает по абсолютным метрикам.

Главная цель PrismML — перенести искусственный интеллект ближе к пользователю . Компания рассчитывает, что компактные модели найдут применение в мобильных устройствах, робототехнике и корпоративных системах, где важны энергоэффективность и контроль над данными. Bonsai 8B уже работает на устройствах Apple через MLX и на GPU Nvidia с помощью llama.cpp. Модель распространяется по лицензии Apache 2.0.

Помимо флагманской версии доступны более лёгкие варианты — Bonsai 4B и Bonsai 1.7B. Компания рассматривает 1-битную архитектуру как отправную точку и намерена развивать это направление дальше.

Легковесные языковые модели долго считались компромиссом между скоростью и качеством. Однако перспективный американский стартап предлагает иной подход, обещая, что мощный ИИ сможет работать прямо на устройствах , без облаков и лишних затрат энергии.

Компания PrismML представила модель Bonsai 8B с необычной архитектурой, где каждый вес нейросети хранится всего в одном бите — фактически как знак «плюс» или «минус». За счёт такого упрощения модель занимает около 1,15 ГБ памяти, оставаясь сопоставимой по качеству с другими решениями того же класса. По данным разработчиков, Bonsai 8B получилась в 14 раз компактнее, работает до 8 раз быстрее и требует в пять раз меньше энергии на периферийных устройствах.

Классические языковые модели на базе трансформеров используют миллионы и миллиарды параметров, представленных в виде чисел с высокой точностью. Чем выше точность — тем больше памяти требуется и тем стабильнее результаты. Уменьшение разрядности обычно ухудшает качество, особенно при сложных рассуждениях и работе с инструментами. В PrismML утверждают, что сумели обойти эти ограничения благодаря новой математической базе, разработанной командой под руководством профессора Калифорнийского технологического института Бабака Хасиби.

Вместо традиционных чисел с плавающей точкой модель использует общий коэффициент масштабирования для групп параметров. Такой подход позволил сохранить способность к логическим цепочкам и точному следованию инструкциям, которые раньше страдали при сильном сжатии.

Разработчики предлагают оценивать модели по новому показателю — «плотности интеллекта». Он учитывает не только точность, но и размер модели. По этому критерию Bonsai 8B заметно опережает конкурентов, включая Qwen3 8B, хотя в ряде тестов уступает по абсолютным метрикам.

Главная цель PrismML — перенести искусственный интеллект ближе к пользователю . Компания рассчитывает, что компактные модели найдут применение в мобильных устройствах, робототехнике и корпоративных системах, где важны энергоэффективность и контроль над данными. Bonsai 8B уже работает на устройствах Apple через MLX и на GPU Nvidia с помощью llama.cpp. Модель распространяется по лицензии Apache 2.0.

Помимо флагманской версии доступны более лёгкие варианты — Bonsai 4B и Bonsai 1.7B. Компания рассматривает 1-битную архитектуру как отправную точку и намерена развивать это направление дальше.