Дешево, сердито и на китайских чипах. DeepSeek представила новую языковую модель V4 с 1,6 трлн параметров

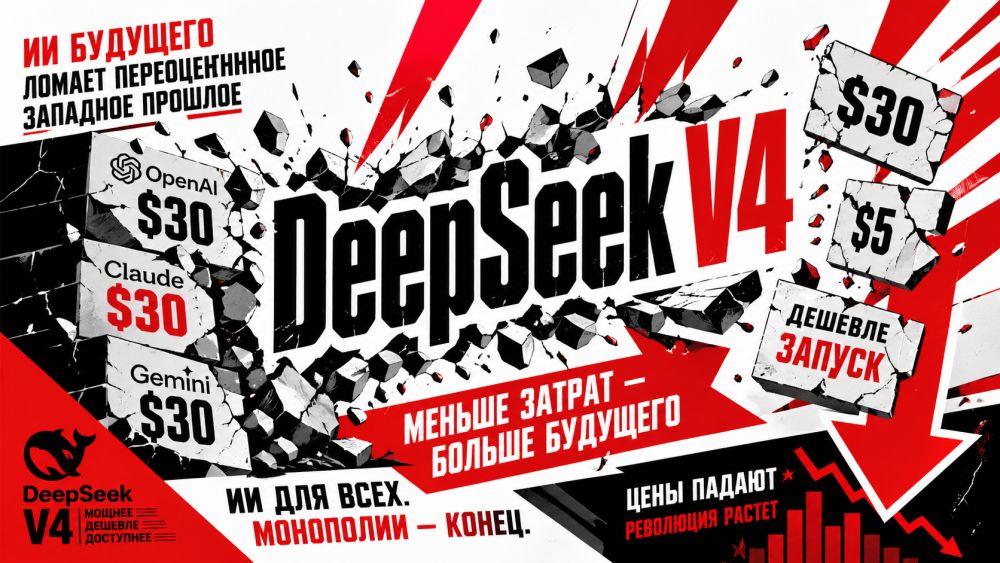

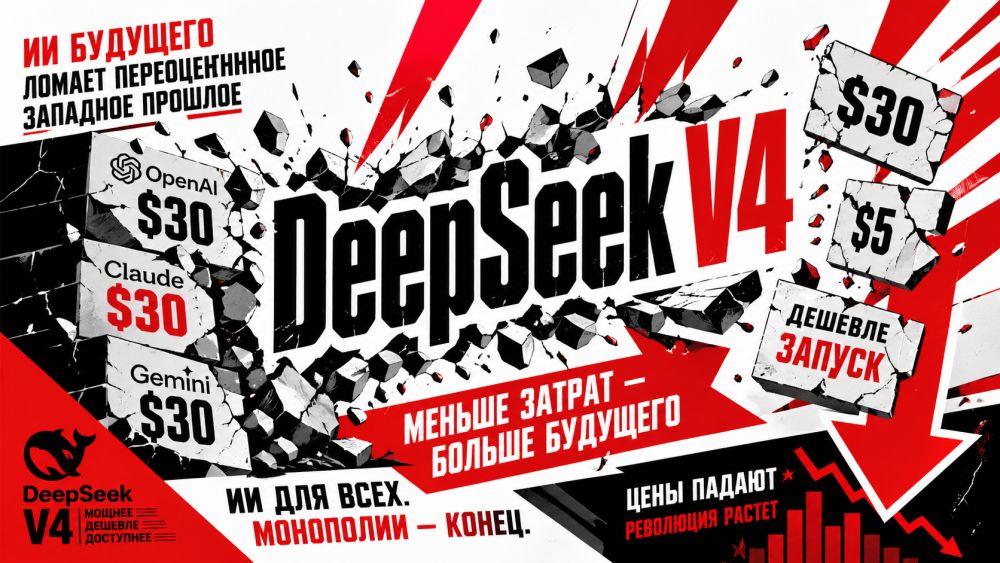

NewsMakerDeepSeek утверждает, что V4-Pro почти догоняет лидеров рынка, но стоит в разы дешевле западных конкурентов.

Китайская DeepSeek снова пытается сломать привычную экономику ИИ. Компания представила DeepSeek V4, новую большую языковую модель с открытыми весами, которая, по словам разработчиков, должна конкурировать с лучшими закрытыми американскими моделями, но обходиться заметно дешевле при запуске. Главная интрига не только в тестах: DeepSeek заявила поддержку ускорителей Huawei Ascend, а значит, китайская ИИ-инфраструктура получает еще один аргумент в пользу ухода от полной зависимости от Nvidia.

DeepSeek V4 вышла сразу в двух версиях. Младшая Flash-модель получила 284 млрд параметров, но во время работы использует только 13 млрд активных параметров. Старшая V4-Pro выросла до 1,6 трлн параметров, из которых в каждый момент задействуются 49 млрд. Обе версии построены по схеме «смеси экспертов», где запрос обрабатывает не вся модель сразу, а выбранные специализированные блоки. Такой подход снижает стоимость ответа и позволяет держать огромную модель в приемлемых рамках по памяти и скорости.

DeepSeek утверждает, что V4-Pro обучили на 33 трлн токенов, а в собственном наборе тестов модель обходит все системы с открытыми весами и приближается к лучшим закрытым решениям Запада. К таким заявлениям стоит относиться осторожно. DeepSeek уже доказала, что умеет делать сильные модели, а семейства V3 и R1 вывели компанию в мировую ИИ-повестку, но красивые результаты в тестах не всегда превращаются в такую же уверенную работу в реальных продуктах, коде, сложных диалогах и корпоративных задачах.

Тем не менее рост по сравнению с прошлыми моделями выглядит ожидаемым. V4-Pro почти на триллион параметров крупнее предыдущих флагманов DeepSeek и использует больше активных параметров при генерации ответа. Но компания снова делает ставку не только на масштаб, а на удешевление работы модели. Именно такой подход сделал DeepSeek V3 заметной: модель показала, что системы переднего края можно обучать и запускать дешевле, чем принято было считать.

Китайская DeepSeek снова пытается сломать привычную экономику ИИ. Компания представила DeepSeek V4, новую большую языковую модель с открытыми весами, которая, по словам разработчиков, должна конкурировать с лучшими закрытыми американскими моделями, но обходиться заметно дешевле при запуске. Главная интрига не только в тестах: DeepSeek заявила поддержку ускорителей Huawei Ascend, а значит, китайская ИИ-инфраструктура получает еще один аргумент в пользу ухода от полной зависимости от Nvidia.

DeepSeek V4 вышла сразу в двух версиях. Младшая Flash-модель получила 284 млрд параметров, но во время работы использует только 13 млрд активных параметров. Старшая V4-Pro выросла до 1,6 трлн параметров, из которых в каждый момент задействуются 49 млрд. Обе версии построены по схеме «смеси экспертов», где запрос обрабатывает не вся модель сразу, а выбранные специализированные блоки. Такой подход снижает стоимость ответа и позволяет держать огромную модель в приемлемых рамках по памяти и скорости.

DeepSeek утверждает, что V4-Pro обучили на 33 трлн токенов, а в собственном наборе тестов модель обходит все системы с открытыми весами и приближается к лучшим закрытым решениям Запада. К таким заявлениям стоит относиться осторожно. DeepSeek уже доказала, что умеет делать сильные модели, а семейства V3 и R1 вывели компанию в мировую ИИ-повестку, но красивые результаты в тестах не всегда превращаются в такую же уверенную работу в реальных продуктах, коде, сложных диалогах и корпоративных задачах.

Тем не менее рост по сравнению с прошлыми моделями выглядит ожидаемым. V4-Pro почти на триллион параметров крупнее предыдущих флагманов DeepSeek и использует больше активных параметров при генерации ответа. Но компания снова делает ставку не только на масштаб, а на удешевление работы модели. Именно такой подход сделал DeepSeek V3 заметной: модель показала, что системы переднего края можно обучать и запускать дешевле, чем принято было считать.