Кажется, ИИ научился «лить воду» не хуже студентов, но на уровне высшей математики

NewsMakerУверенность теперь маскирует неверные выводы лучше, чем раньше маскировала слабого автора.

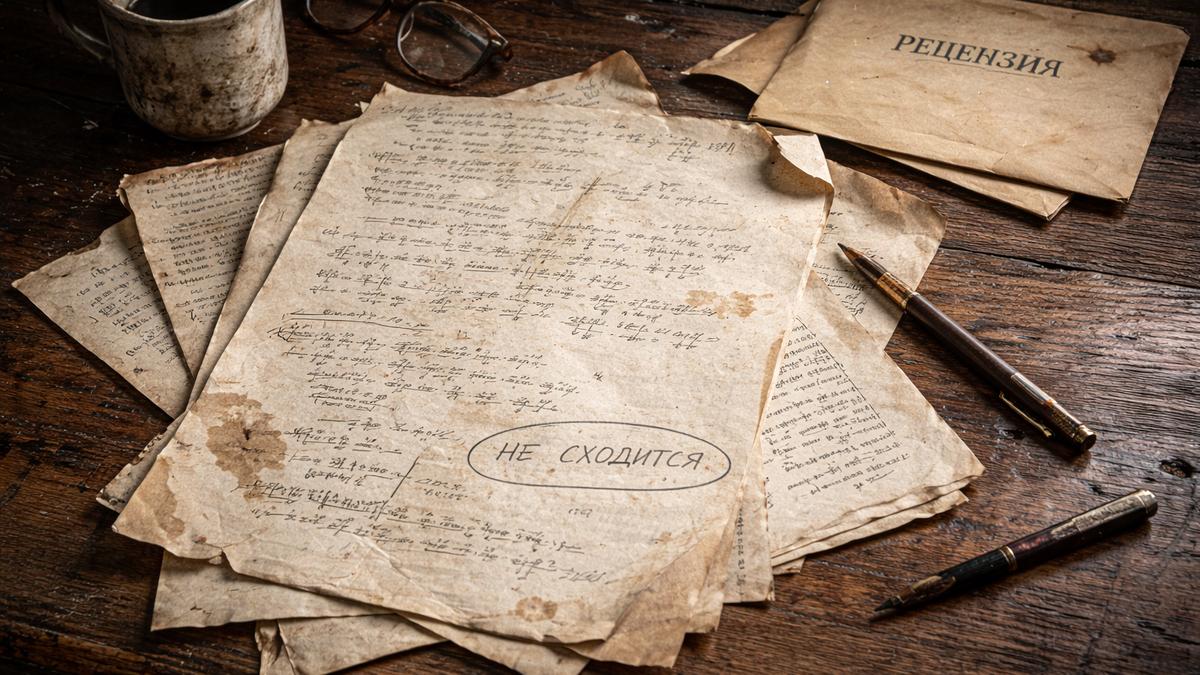

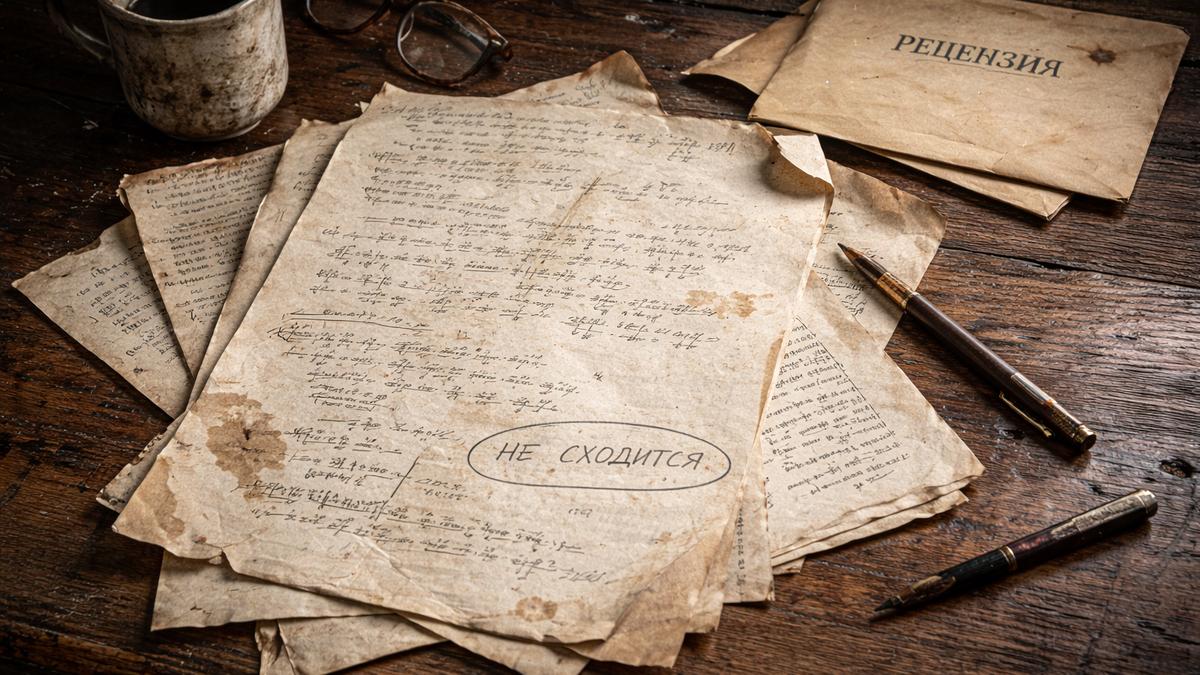

Если раньше математика держалась на простом принципе «убедил коллег, значит доказал», теперь принцип получил опасного двойника. ИИ уже научился писать доказательства так уверенно и гладко, что тексты выглядят безупречно даже в местах, где спрятана ошибка. Математики все чаще спрашивают себя, как не принять красивую подачу за истину, особенно когда «красиво» пишет машина.

Повод для тревоги появился после закрытой встречи в 2025 году. На встрече ведущие специалисты по математике тестировали модель OpenAI o4-mini. По словам участников, ответы звучали так, будто текст пишет живой исследователь, который ведет мысль и удерживает в голове сложную конструкцию доказательства. Профессор теории чисел Кен Оно из Университета Вирджинии вспоминал, что раньше не встречал у моделей подобной манеры рассуждать, и сравнил увиденное с работой ученого.

Чем убедительнее звучит машина, тем проще продавить слабое место в логике. Кен Оно прямо признавал, что модель способна выдавать правдоподобные, но неверные решения. По формулировке Кена Оно, o4-mini освоила «доказательство запугиванием» когда авторитетная подача заставляет читателя сомневаться не в тексте, а в собственной компетентности.

Математик Терри Тао из UCLA объясняет проблему проще. Раньше стиль служил сигналом качества. Слабый математик обычно пишет хуже и расставляет акценты мимо цели. С ИИ сигнал ломается. Модель идеально имитирует форму строгого рассуждения и при этом ошибается, оставаясь одинаково убедительной в обоих вариантах. Отсюда страх получить поток «железобетонных» доказательств с тонкими изъянами, которые трудно поймать человеческим глазом.

Повод для тревоги появился после закрытой встречи в 2025 году. На встрече ведущие специалисты по математике тестировали модель OpenAI o4-mini. По словам участников, ответы звучали так, будто текст пишет живой исследователь, который ведет мысль и удерживает в голове сложную конструкцию доказательства. Профессор теории чисел Кен Оно из Университета Вирджинии вспоминал, что раньше не встречал у моделей подобной манеры рассуждать, и сравнил увиденное с работой ученого.

Чем убедительнее звучит машина, тем проще продавить слабое место в логике. Кен Оно прямо признавал, что модель способна выдавать правдоподобные, но неверные решения. По формулировке Кена Оно, o4-mini освоила «доказательство запугиванием» когда авторитетная подача заставляет читателя сомневаться не в тексте, а в собственной компетентности.

Математик Терри Тао из UCLA объясняет проблему проще. Раньше стиль служил сигналом качества. Слабый математик обычно пишет хуже и расставляет акценты мимо цели. С ИИ сигнал ломается. Модель идеально имитирует форму строгого рассуждения и при этом ошибается, оставаясь одинаково убедительной в обоих вариантах. Отсюда страх получить поток «железобетонных» доказательств с тонкими изъянами, которые трудно поймать человеческим глазом.