«На свой страх и риск». Microsoft признала, что доверять Copilot нельзя

NewsMakerКупили ноутбук за 2000 долларов, чтобы играть в нейросеть.

Microsoft активно продвигает своего помощника Copilot как универсальный инструмент для работы и повседневных задач. Компания встроила его в Word, Windows и даже выпустила отдельную линейку компьютеров Copilot+ PC . Но в пользовательском соглашении скрывается формулировка, которая резко контрастирует с этим образом.

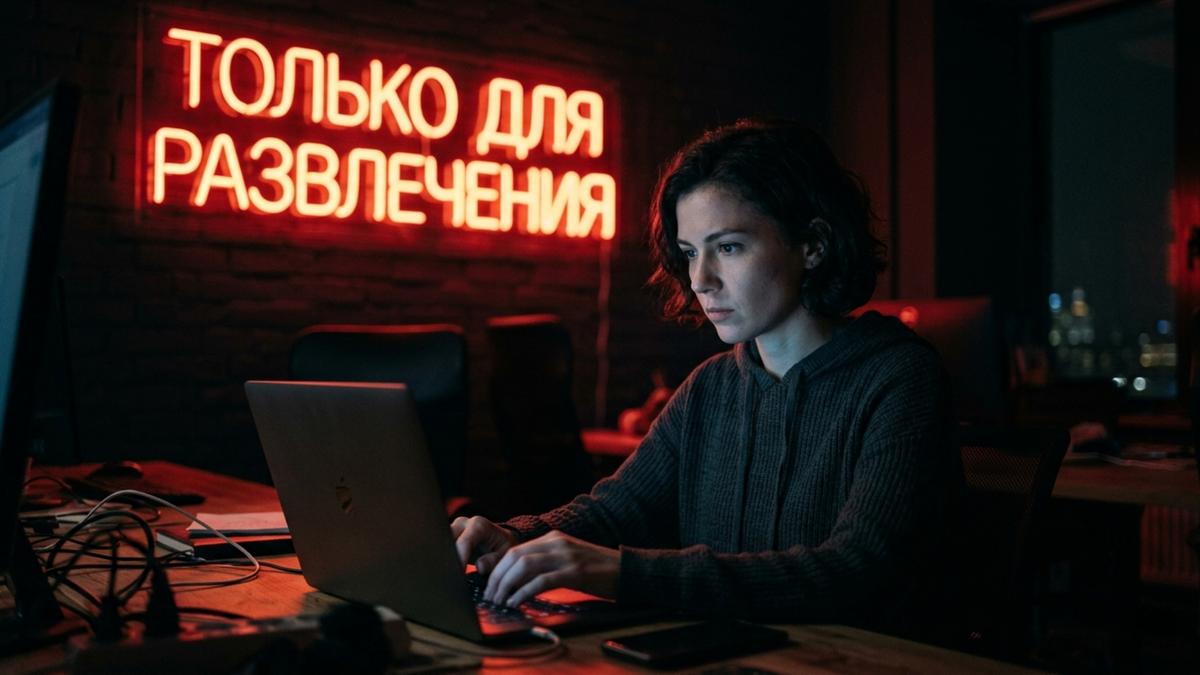

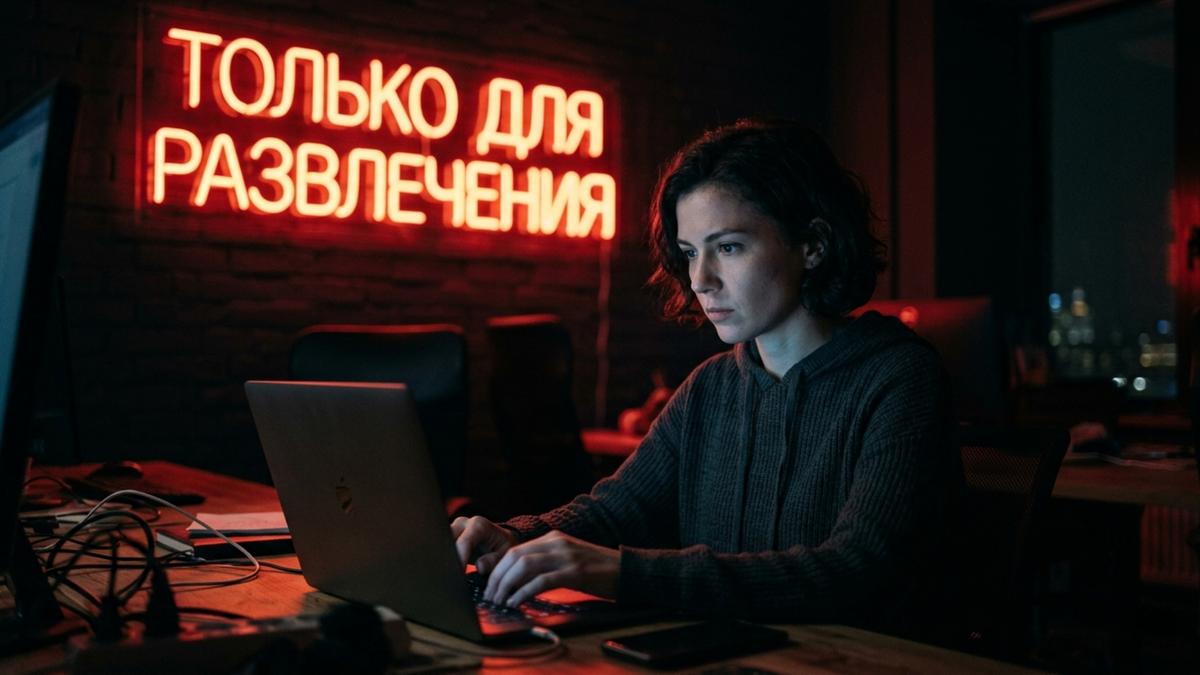

В обновлённых условиях использования Copilot, вступивших в силу 24 октября 2025 года, прямо сказано: сервис предназначен «только для развлекательных целей». Там же предупреждают, что Copilot может ошибаться и работать некорректно, а полагаться на него при принятии важных решений не стоит. Пользователь действует на свой страх и риск.

Документ идёт дальше. Microsoft не гарантирует, что ответы Copilot не нарушают чужие права , а вся ответственность за публикацию или распространение сгенерированного контента ложится на пользователя. Кроме того, компания оставляет за собой право в любой момент ограничить, приостановить или полностью закрыть доступ к Copilot без предупреждения и объяснений.

Формально подобные оговорки встречаются почти у всех разработчиков систем на базе искусственного интеллекта. Разработчики признают, что модели иногда выдают недостоверную информацию и не подходят для роли надёжного источника. Однако формулировка «только для развлечения» выглядит особенно жёстко на фоне того, как Microsoft позиционирует Copilot – как полноценного помощника для работы и повышения продуктивности.

В новых условиях также уточнили правила для функций Copilot Actions , Copilot Labs и встроенных покупок. Если пользователь поручает Copilot выполнить какое-либо действие, ответственность за последствия полностью лежит на самом пользователе.

Представитель Microsoft также заявил , что формулировка про «развлекательные цели» – устаревшая. Она осталась со времён, когда Copilot запускали как дополнение к поиску Bing, и не отражает текущие сценарии использования. В компании пообещали изменить текст в ближайшем обновлении.

Microsoft активно продвигает своего помощника Copilot как универсальный инструмент для работы и повседневных задач. Компания встроила его в Word, Windows и даже выпустила отдельную линейку компьютеров Copilot+ PC . Но в пользовательском соглашении скрывается формулировка, которая резко контрастирует с этим образом.

В обновлённых условиях использования Copilot, вступивших в силу 24 октября 2025 года, прямо сказано: сервис предназначен «только для развлекательных целей». Там же предупреждают, что Copilot может ошибаться и работать некорректно, а полагаться на него при принятии важных решений не стоит. Пользователь действует на свой страх и риск.

Документ идёт дальше. Microsoft не гарантирует, что ответы Copilot не нарушают чужие права , а вся ответственность за публикацию или распространение сгенерированного контента ложится на пользователя. Кроме того, компания оставляет за собой право в любой момент ограничить, приостановить или полностью закрыть доступ к Copilot без предупреждения и объяснений.

Формально подобные оговорки встречаются почти у всех разработчиков систем на базе искусственного интеллекта. Разработчики признают, что модели иногда выдают недостоверную информацию и не подходят для роли надёжного источника. Однако формулировка «только для развлечения» выглядит особенно жёстко на фоне того, как Microsoft позиционирует Copilot – как полноценного помощника для работы и повышения продуктивности.

В новых условиях также уточнили правила для функций Copilot Actions , Copilot Labs и встроенных покупок. Если пользователь поручает Copilot выполнить какое-либо действие, ответственность за последствия полностью лежит на самом пользователе.

Представитель Microsoft также заявил , что формулировка про «развлекательные цели» – устаревшая. Она осталась со времён, когда Copilot запускали как дополнение к поиску Bing, и не отражает текущие сценарии использования. В компании пообещали изменить текст в ближайшем обновлении.