Робот стоит — лицо как живое. Улыбается — жуть. Пришлось собрать 200 тысяч 3D-лиц, чтобы научить машины мимике

NewsMakerУченые нашли спасение от эффекта зловещей долины.

Лицо гуманоидного робота может выглядеть почти как человеческое, пока робот стоит неподвижно. Проблемы начинаются в момент, когда робот улыбается, хмурится или просто поворачивает голову. Мелкие детали мимики смещаются на доли сантиметра, и выражение лица сразу кажется неестественным. Чаще всего виновато неточное понимание алгоритмом трёхмерной формы лица: алгоритм неверно ставит ключевые точки , по которым строится мимика и отслеживается движение.

Группа исследователей из Китая предложила подход , который опирается не на текстуры и фотографии, а на реальную геометрию. Команда собрала крупную базу трёхмерных сканов лиц и разработала модель, которая находит ключевые лицевые точки прямо в 3D-данных. Такой метод не требует 2D-изображений, не зависит от натягивания текстуры на модель и не привязан к заранее подготовленным цифровым шаблонам.

Для реалистичных гуманоидных роботов и виртуальных персонажей точность таких точек критична. По этим ориентирам строится каркас лица: положение уголков губ, контур век, линии бровей, форма носа и другие зоны, которые задают выражение. Если опорные точки смещаются даже немного, улыбка выглядит странно, эмоция считывается неверно, а система трекинга теряет стабильность при движении головы или при смене выражения. Отсюда и всем известный эффект зловещей долины.

Большинство существующих решений до сих пор сильно зависят от 2D-слоя. Алгоритмы получают фотографию, совмещают её с трёхмерной моделью и пытаются вычислить ключевые точки, ориентируясь на изображение. Другой распространённый метод - обучение на синтетических 3D-лицах. Оба варианта имеют слабые места. Цифровые модели часто отличаются от реальной анатомии, а совмещение текстуры с геометрией даёт погрешности, особенно при сложном освещении или при необычной форме лица, которая плохо укладывается в стандартные шаблоны.

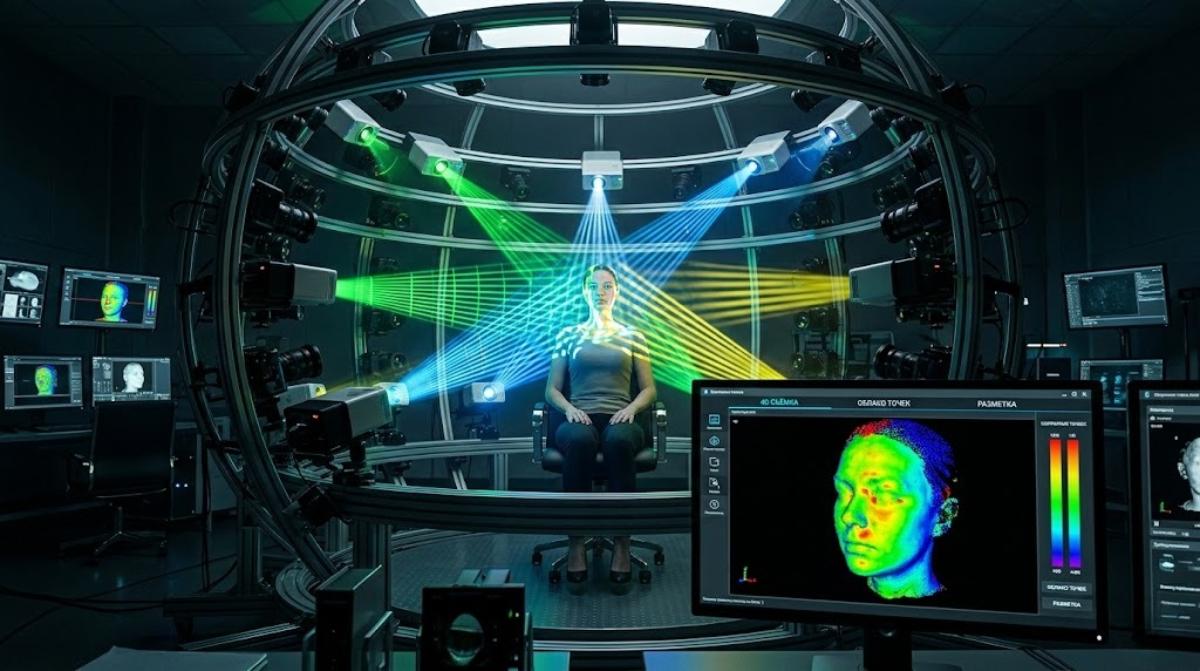

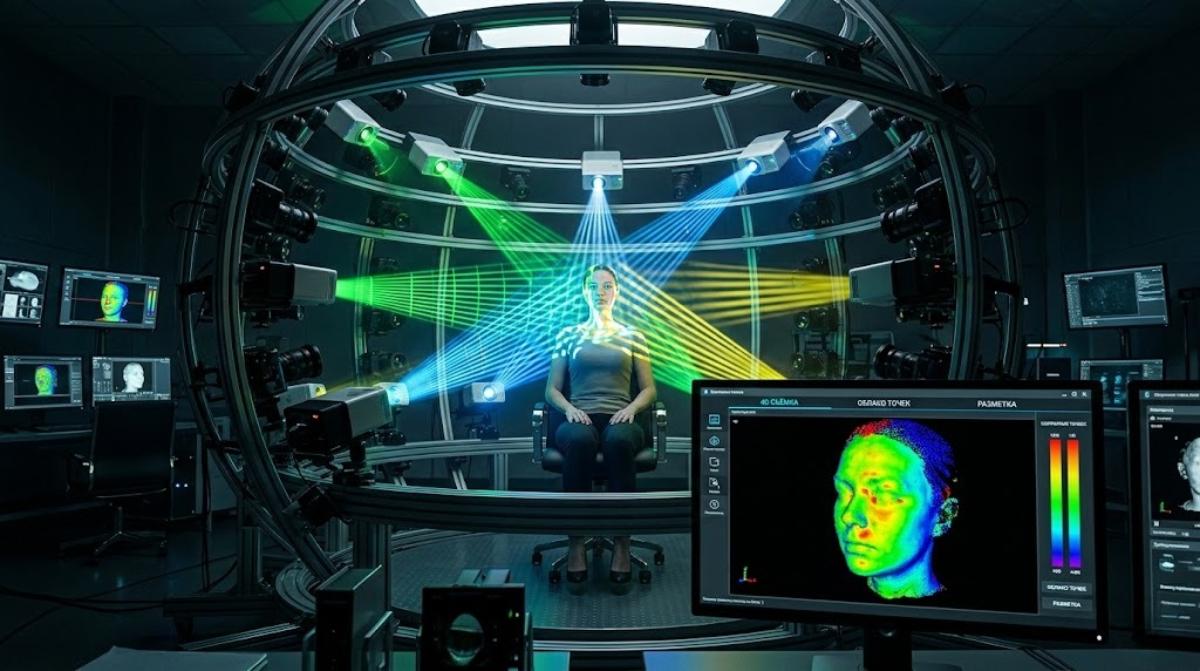

Исследование возглавили профессор Сун Чжань из Шэньчжэньского института передовых технологий Китайской академии наук и доктор Е Юпин из Фуцзяньского университета технологий. Для проекта команда собрала собственную установку для 3D- и 4D-съёмки лица. В таких работах 4D означает 3D-сканы, снятые во времени: система фиксирует не один объёмный кадр, а последовательность объёмных кадров и показывает, как меняется лицо при мимике.

На этой установке исследователи провели стандартизированный сбор данных и подготовили базу примерно из 200 тысяч высокоточных 3D-сканов лиц. Внутри базы несколько связанных наборов: коллекция 3D-лиц с разными выражениями, отдельный набор с разметкой ключевых точек, высокоточный 3D-набор данных по человеческому телу, а также динамический набор 4D-выражений. Авторы называют получившийся комплект одной из крупнейших структурированных коллекций реальных трёхмерных биометрических данных, опубликованных на сегодня. Датасет также отобрали в программу Fujian Province 2025 High-Quality AI Dataset Program.

Вторая часть работы посвящена модели, которая читает 3D-скан без опоры на фотографии. На вход подают не изображение с текстурой, а облако точек: набор координат в пространстве, который описывает форму лица. Каждая точка задаёт участок поверхности, но без цвета и без картинки - только геометрия.

С такими данными трудно работать по двум причинам. Во-первых, точек обычно очень много. Во-вторых, у облака точек нет естественного порядка: перестановка точек местами ничего не меняет, но для многих алгоритмов порядок важен. Поэтому команда построила модель, рассчитанную именно на такой формат, и назвала её curvature-fused graph attention network (CF-GAT). Модель превращает облако точек в граф: связывает близкие точки и учится по этим связям находить участки, которые помогают точнее поставить ориентиры.

Чтобы ускорить обработку и не потерять важные детали формы, исследователи добавили геометрическую стратегию выборки. Алгоритм сокращает число точек, но старается сохранить области с заметной кривизной, где форма быстро меняется. Такие места чаще всего и нужны для разметки: край ноздри, линия губ, изгиб века, переходы вокруг бровей. Информацию о кривизне команда не оставила «внутри» модели как скрытый признак, а передала явно и встроила в механизм внимания как геометрический приоритет. В результате CF-GAT лучше замечает мелкие локальные изгибы и одновременно удерживает общую картину лица, чтобы точки не расползались при повороте головы или смене выражения.

В таком виде CF-GAT предсказывает координаты ключевых точек напрямую по геометрии и меньше зависит от внешнего вида поверхности. В экспериментах авторы отмечают более высокую устойчивость к шуму и более надёжный перенос на разные типы лиц по сравнению с подходами, которые опираются на текстуры, 2D-изображения или синтетические 3D-модели. Отдельно улучшилась точность на мелких ориентирах, где даже небольшая ошибка заметно портит мимику и сбивает трекинг.

Авторы связывают результат с обучением на большом массиве реальных сканов. Такая база помогает модели увидеть то, что часто теряется в синтетике: естественную асимметрию лица, редкие варианты формы и небольшие анатомические особенности, которые сильно влияют на выражения и на то, как лицо выглядит в движении.

Разработка может пригодиться в нескольких областях: в создании более правдоподобных гуманоидах и аватарах , в биометрии и в системах, которые управляют лицевой анимацией виртуальных персонажей. По мере того как андроиды появляются в развлечениях, медицине и сервисе, точная работа с трёхмерной геометрией лица всё чаще определяет, насколько естественно робот выражает эмоции и насколько уверенно взаимодействует с человеком.

Лицо гуманоидного робота может выглядеть почти как человеческое, пока робот стоит неподвижно. Проблемы начинаются в момент, когда робот улыбается, хмурится или просто поворачивает голову. Мелкие детали мимики смещаются на доли сантиметра, и выражение лица сразу кажется неестественным. Чаще всего виновато неточное понимание алгоритмом трёхмерной формы лица: алгоритм неверно ставит ключевые точки , по которым строится мимика и отслеживается движение.

Группа исследователей из Китая предложила подход , который опирается не на текстуры и фотографии, а на реальную геометрию. Команда собрала крупную базу трёхмерных сканов лиц и разработала модель, которая находит ключевые лицевые точки прямо в 3D-данных. Такой метод не требует 2D-изображений, не зависит от натягивания текстуры на модель и не привязан к заранее подготовленным цифровым шаблонам.

Для реалистичных гуманоидных роботов и виртуальных персонажей точность таких точек критична. По этим ориентирам строится каркас лица: положение уголков губ, контур век, линии бровей, форма носа и другие зоны, которые задают выражение. Если опорные точки смещаются даже немного, улыбка выглядит странно, эмоция считывается неверно, а система трекинга теряет стабильность при движении головы или при смене выражения. Отсюда и всем известный эффект зловещей долины.

Большинство существующих решений до сих пор сильно зависят от 2D-слоя. Алгоритмы получают фотографию, совмещают её с трёхмерной моделью и пытаются вычислить ключевые точки, ориентируясь на изображение. Другой распространённый метод - обучение на синтетических 3D-лицах. Оба варианта имеют слабые места. Цифровые модели часто отличаются от реальной анатомии, а совмещение текстуры с геометрией даёт погрешности, особенно при сложном освещении или при необычной форме лица, которая плохо укладывается в стандартные шаблоны.

Исследование возглавили профессор Сун Чжань из Шэньчжэньского института передовых технологий Китайской академии наук и доктор Е Юпин из Фуцзяньского университета технологий. Для проекта команда собрала собственную установку для 3D- и 4D-съёмки лица. В таких работах 4D означает 3D-сканы, снятые во времени: система фиксирует не один объёмный кадр, а последовательность объёмных кадров и показывает, как меняется лицо при мимике.

На этой установке исследователи провели стандартизированный сбор данных и подготовили базу примерно из 200 тысяч высокоточных 3D-сканов лиц. Внутри базы несколько связанных наборов: коллекция 3D-лиц с разными выражениями, отдельный набор с разметкой ключевых точек, высокоточный 3D-набор данных по человеческому телу, а также динамический набор 4D-выражений. Авторы называют получившийся комплект одной из крупнейших структурированных коллекций реальных трёхмерных биометрических данных, опубликованных на сегодня. Датасет также отобрали в программу Fujian Province 2025 High-Quality AI Dataset Program.

Вторая часть работы посвящена модели, которая читает 3D-скан без опоры на фотографии. На вход подают не изображение с текстурой, а облако точек: набор координат в пространстве, который описывает форму лица. Каждая точка задаёт участок поверхности, но без цвета и без картинки - только геометрия.

С такими данными трудно работать по двум причинам. Во-первых, точек обычно очень много. Во-вторых, у облака точек нет естественного порядка: перестановка точек местами ничего не меняет, но для многих алгоритмов порядок важен. Поэтому команда построила модель, рассчитанную именно на такой формат, и назвала её curvature-fused graph attention network (CF-GAT). Модель превращает облако точек в граф: связывает близкие точки и учится по этим связям находить участки, которые помогают точнее поставить ориентиры.

Чтобы ускорить обработку и не потерять важные детали формы, исследователи добавили геометрическую стратегию выборки. Алгоритм сокращает число точек, но старается сохранить области с заметной кривизной, где форма быстро меняется. Такие места чаще всего и нужны для разметки: край ноздри, линия губ, изгиб века, переходы вокруг бровей. Информацию о кривизне команда не оставила «внутри» модели как скрытый признак, а передала явно и встроила в механизм внимания как геометрический приоритет. В результате CF-GAT лучше замечает мелкие локальные изгибы и одновременно удерживает общую картину лица, чтобы точки не расползались при повороте головы или смене выражения.

В таком виде CF-GAT предсказывает координаты ключевых точек напрямую по геометрии и меньше зависит от внешнего вида поверхности. В экспериментах авторы отмечают более высокую устойчивость к шуму и более надёжный перенос на разные типы лиц по сравнению с подходами, которые опираются на текстуры, 2D-изображения или синтетические 3D-модели. Отдельно улучшилась точность на мелких ориентирах, где даже небольшая ошибка заметно портит мимику и сбивает трекинг.

Авторы связывают результат с обучением на большом массиве реальных сканов. Такая база помогает модели увидеть то, что часто теряется в синтетике: естественную асимметрию лица, редкие варианты формы и небольшие анатомические особенности, которые сильно влияют на выражения и на то, как лицо выглядит в движении.

Разработка может пригодиться в нескольких областях: в создании более правдоподобных гуманоидах и аватарах , в биометрии и в системах, которые управляют лицевой анимацией виртуальных персонажей. По мере того как андроиды появляются в развлечениях, медицине и сервисе, точная работа с трёхмерной геометрией лица всё чаще определяет, насколько естественно робот выражает эмоции и насколько уверенно взаимодействует с человеком.